微软VASA-1深度伪造技术突破:暂不对外发布,真实度惊人

微软揭示VASA-1深度伪造技术突破,因潜在滥用风险决定暂不对外发布

视频版本:https://m.ixigua.com/7360213530127270452

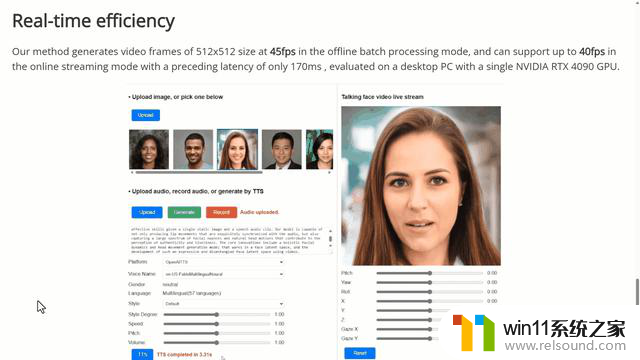

近日,全球科技巨头微软公司在其亚洲研究院的一项最新研究成果中。演示了一项名为VASA-1的深度伪造技术,该技术凭借其前所未有的高精度和真实性,在静态图像、音频样本及文本脚本基础上,能够创造出几乎无法辨识真假的人物说话视频。然而,鉴于该技术所能带来的潜在社会风险与伦理挑战,微软方面谨慎地宣布,VASA-1暂时不会面向公众开放或商业化。

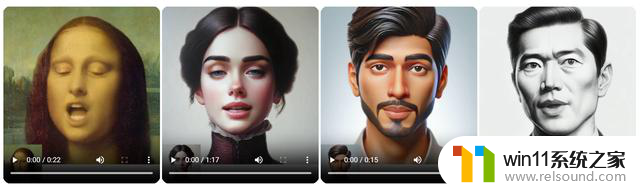

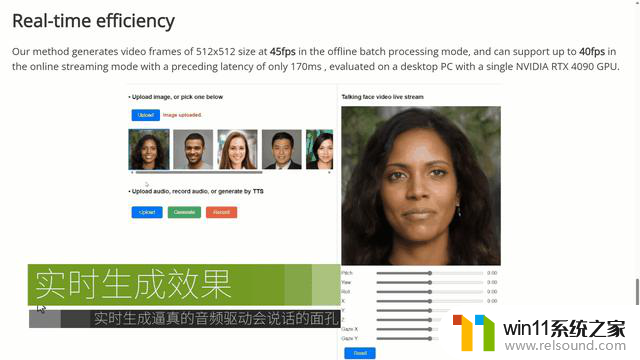

VASA-1模型利用先进的机器学习算法,只需用户提供一张静态的照片和一段语音样本,就能够实时生成与音频完全同步且具有高度细节的面部表情和口形动画。这一突破性进展不仅使得经典画作中的角色仿佛能开口对话,甚至还能创造出栩栩如生的虚拟演讲者,极大地拓展了媒体创作和虚拟交互的可能性。

然而,正如微软研究人员指出,随着深度伪造技术愈发成熟,其所带来的负面效应也日益凸显。网络安全机构Deeptrace在过去的评估中发现,深度伪造技术在非自愿色情内容及其他恶意用途中的比例高达96%。这无疑加剧了公众对于VASA-1这类技术可能被滥用的担忧。

鼠标凝视

微软公司在审慎评估后明确表示,尽管VASA-1展现出了在娱乐、教育和创意产业的巨大潜力。但出于对社会公共利益以及个人隐私保护的考量,现阶段并不适宜将其公之于众或广泛应用于商业场景。微软强调了在推动技术创新的同时,确保AI技术负责任使用的必要性,并呼吁行业内外共同探讨如何建立有效的监管机制,防止此类先进技术被用于非法或不道德的目的。

微软将继续深入研究并探索如何在严格的安全控制和法律法规框架下发展VASA-1这类技术,同时鼓励业界加强深度伪造检测技术的研发,以平衡科技进步与社会安全的需求。在未来,只有当相应的风险管理措施得到充分部署和完善,VASA-1及其后续技术才有可能在更为安全可控的环境中服务于广大用户和社会。