ChatGPT引爆人工智能芯片大战,英伟达独霸时代结束

ChatGPT爆火之后,谷歌和微软两巨头的AI大战战火,已经烧到了新的领域——服务器芯片。

如今,AI和云计算都成了必争之地,而芯片,也成为降低成本、赢得商业客户的关键。

原本,亚马逊、微软、谷歌这类大厂,都是以软件而闻名的,而现在,它们纷纷斥资数十亿美元,用于芯片开发和生产。

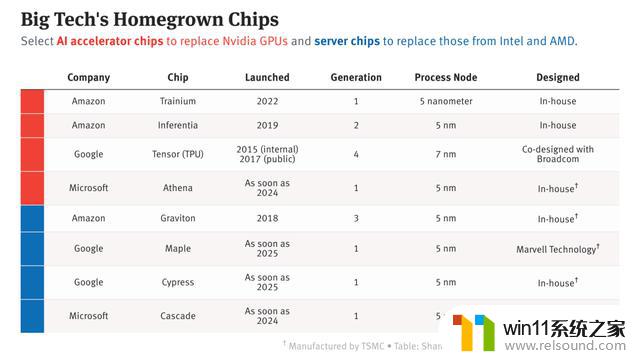

各大科技巨头研发的AI芯片

ChatGPT爆火,大厂开启芯片争霸赛

根据外媒The Information的报道以及其他来源,这三家大厂现在已经推出或计划发布8款服务器和AI芯片,用于内部产品开发、云服务器租赁或者二者兼有。

「如果你能制造出针对AI进行优化的硅,那前方等待你的将是巨大的胜利」,研究公司Forrester的董事Glenn O’Donnell这样说。

付出这些巨大的努力,一定会得到回报吗?

答案是,并不一定。

英特尔、AMD和英伟达可以从规模经济中获益,但对大型科技公司来说,情况远非如此。

它们还面临着许多棘手的挑战,比如需要聘请芯片设计师,还要说服开发者使用他们定制的芯片构建应用程序。

不过,大厂们已经在这一领域取得了令人瞩目的进步。

根据公布的性能数据,亚马逊的Graviton服务器芯片,以及亚马逊和谷歌发布的AI专用芯片,在性能上已经可以和传统的芯片厂商相媲美。

亚马逊、微软和谷歌为其数据中心开发的芯片,主要有这两种:标准计算芯片和用于训练和运行机器学习模型的专用芯片。正是后者,为ChatGPT之类的大语言模型提供了动力。

此前,苹果成功地为iPhone,iPad和Mac开发了芯片,改善了一些AI任务的处理。这些大厂,或许正是跟苹果学来的灵感。

在三家大厂中,亚马逊是唯一一家在服务器中提供两种芯片的云服务商,2015年收购的以色列芯片设计商Annapurna Labs,为这些工作奠定了基础。

谷歌在2015年推出了一款用于AI工作负载的芯片,并正在开发一款标准服务器芯片,以提高谷歌云的服务器性能。

相比之下,微软的芯片研发开始得较晚,是在2019年启动的,而最近,微软更加快了推出专为LLM设计的AI芯片的时间轴。

而ChatGPT的爆火,点燃了全世界用户对于AI的兴奋。这更促进了三家大厂的战略转型。

ChatGPT运行在微软的Azure云上,使用了上万块英伟达A100。无论是ChatGPT,还是其他整合进Bing和各种程序的OpenAI软件,都需要如此多的算力,以至于微软已经为开发AI的内部团队分配了服务器硬件。

在亚马逊,首席财务官Brian Olsavsky在上周的财报电话会议上告诉投资者,亚马逊计划将支出从零售业务转移到AWS,部分原因是投资于支持ChatGPT所需的基础设施。

在谷歌,负责制造张量处理单元的工程团队已经转移到谷歌云。据悉,云组织现在可以为TPU和在其上运行的软件制定路线图,希望让云客户租用更多TPU驱动的服务器。

谷歌:为AI特调的TPU V4

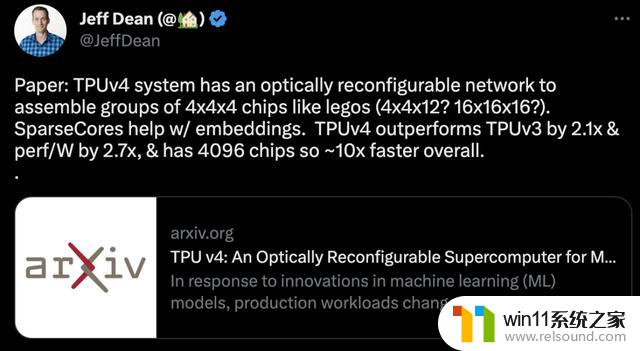

早在2020年,谷歌就在自家的数据中心上部署了当时最强的AI芯片——TPU v4。

不过直到今年的4月4日,谷歌才首次公布了这台AI超算的技术细节。

相比于TPU v3,TPU v4的性能要高出2.1倍,而在整合4096个芯片之后,超算的性能更是提升了10倍。

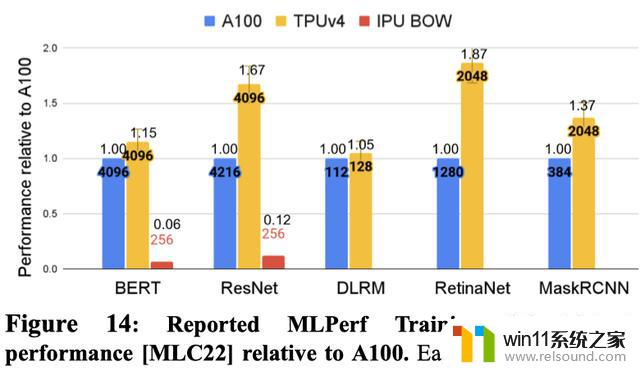

同时,谷歌还声称,自家芯片要比英伟达A100更快、更节能。对于规模相当的系统,TPU v4可以提供比英伟达A100强1.7倍的性能,同时在能效上也能提高1.9倍。

对于相似规模的系统,TPU v4在BERT上比A100快1.15倍,比IPU快大约4.3倍。对于ResNet,TPU v4分别快1.67倍和大约4.5倍。

另外,谷歌曾暗示,它正在研发一款与Nvidia H100竞争的新TPU。谷歌研究员Jouppi在接受路透社采访时表示,谷歌拥有「未来芯片的生产线」。

微软:秘密武器雅典娜

不管怎么说,微软在这场芯片纷争中,依旧跃跃欲试。

此前有消息爆出,微软秘密组建的300人团队,在2019年时就开始研发一款名为「雅典娜」(Athena)的定制芯片。

根据最初的计划,「雅典娜」会使用台积电的5nm工艺打造,预计可以将每颗芯片的成本降低1/3。

如果在明年能够大面积实装,微软内部和OpenAI的团队便可以借助「雅典娜」同时完成模型的训练和推理。

这样一来,就可以极大地缓解专用计算机紧缺的问题。

彭博社在上周的报道中,称微软的芯片部门已与AMD合作开发雅典娜芯片,这也导致AMD的股价在周四上涨了6.5%。

但一位知情者表示,AMD并未参与其中,而是在开发自己的GPU,与英伟达竞争,并且AMD一直在与微软讨论芯片的设计,因为微软预计要购买这款GPU。

亚马逊:已抢跑一个身位

而在与微软和谷歌的芯片竞赛中,亚马逊似乎已经领先了一个身位。

在过去的十年中,亚马逊在云计算服务方面,通过提供更加先进的技术和更低的价格,一直保持了对微软和谷歌的竞争优势。

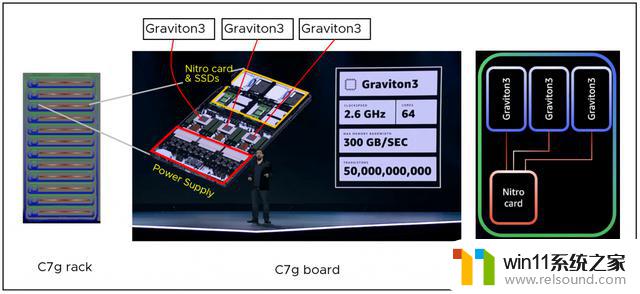

而未来十年内,亚马逊也有望通过自己内部开发的服务器芯片——Graviton,继续在竞争中保持优势。

作为最新一代的处理器,AWS Graviton3在计算性能上比上一代提高多达25%,浮点性能提高多达2倍。并支持DDR5内存,相比DDR4内存带宽增加了50%。

针对机器学习工作负载,AWS Graviton3比上一代的性能高出多达3倍,并支持 bfloat16。

基于Graviton 3芯片的云服务在一些地区非常受欢迎,甚至于达到了供不应求的状态。

亚马逊另一方面的优势还表现在,它是目前唯一一家在其服务器中提供标准计算芯片(Graviton)和AI专用芯片(Inferentia和Trainium)云供应商。

早在2019年,亚马逊就推出了自己的AI推理芯片——Inferentia。

它可以让客户可以在云端低成本运行大规模机器学习推理应用程序,例如图像识别、语音识别、自然语言处理、个性化和欺诈检测。

而最新的Inferentia 2更是在计算性能提高了3倍,加速器总内存扩大了4倍,吞吐量提高了4倍,延迟降低到1/10。

在初代Inferentia推出之后,亚马逊又发布了其设计的主要用于AI训练的定制芯片——Trainium。

它对深度学习训练工作负载进行了优化,包括图像分类、语义搜索、翻译、语音识别、自然语言处理和推荐引擎等。

在一些情况下,芯片定制不仅仅可以把成本降低一个数量级,能耗减少到1/10,并且这些定制化的方案可以给客户以更低的延迟提供更好的服务。

撼动英伟达的垄断,没那么容易

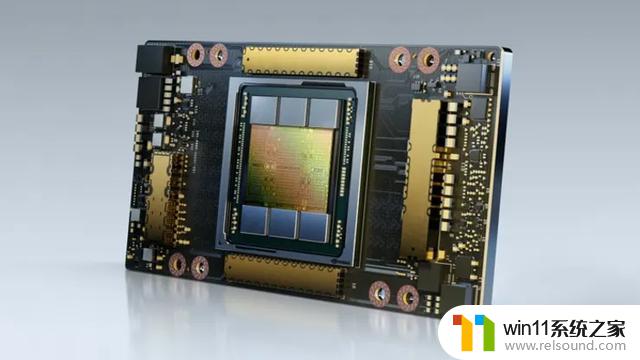

不过到目前为止,大多数的AI负载还是跑在GPU上的,而英伟达生产了其中的大部分芯片。

据此前报道,英伟达独立GPU市场份额达80%,在高端GPU市场份额高达90%。

20年,全世界跑AI的云计算与数据中心,80.6%都由英伟达GPU驱动。21年,英伟达表示,全球前500个超算中,大约七成是由自家的芯片驱动。

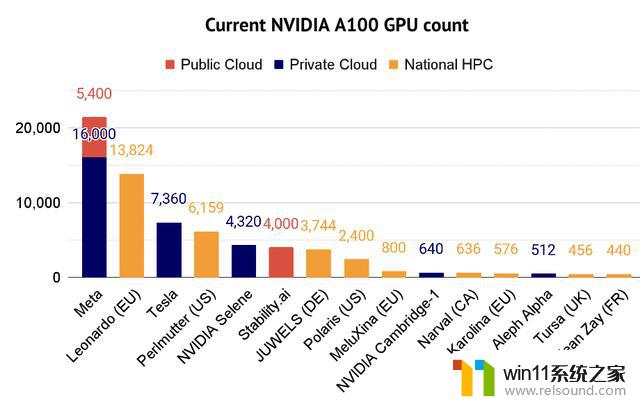

而现在,就连运行ChatGPT的微软数据中心用了上万块英伟达A100 GPU。

一直以来,不管是成为顶流的ChatGPT,还是Bard、Stable Diffusion等模型,背后都是由每个大约价值1万美元的芯片英伟达A100提供算力。

不仅如此,A100目前已成为人工智能专业人士的「主力」。2022人工智能现状报告还列出了使用A100超级计算机部分公司的名单。

显而易见,英伟达已经垄断了全球算力,凭借自家的芯片,一统江湖。

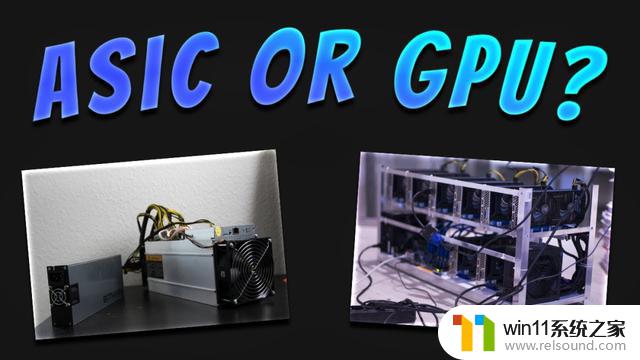

根据从业者的说法,相比于通用芯片,亚马逊、谷歌和微软一直在研发的专用集成电路(ASIC)芯片,在执行机器学习任务的速度更快,功耗更低。

O’Donnell董事在比较GPU和ASIC时,用了这样一个比较:「平时开车,你可以用普锐斯,但如果你必须在山上用四轮驱动,用吉普牧马人就会更合适。」

然而尽管已经做出了种种努力,但亚马逊、谷歌和微软都面临着挑战——如何说服开发者使用这些AI芯片呢?

现在,英伟达的GPU是占主导地位的,开发者早已熟悉其专有的编程语言CUDA,用于制作GPU驱动的应用程序。

如果换到亚马逊、谷歌或微软的定制芯片,就需要学习全新的软件语言了,他们会愿意吗?

参考资料:

https://m.theinformation.com/articles/google-and-microsofts-other-ai-race-server-chips?rc=epv9gi

https://m.theregister.com/2023/05/09/intel_layoffs_coming/